Die früher am heutigen Tag durchgesickerten Informationen zum Thema Kindersicherheit sind nun offiziell. Auf einer neuen Webseite hat Apple dabei auch Informationen zu dem vorhin thematisierten Abgleich von Fotos auf dem iPhone, iPad und Mac mit Hashwerten zur Erkennung von Kindesmissbrauch bekanntgegeben. Dieser wird allerdings nur ein Teil einer größer angelegten Offensive zum Thema Kindersicherheit sein, die zunächst ausschließlich in den USA, später aber auch in anderen Regionen, mit iOS 15, iPadOS 15 und macOS Monterey umgesetzt wird.

Die früher am heutigen Tag durchgesickerten Informationen zum Thema Kindersicherheit sind nun offiziell. Auf einer neuen Webseite hat Apple dabei auch Informationen zu dem vorhin thematisierten Abgleich von Fotos auf dem iPhone, iPad und Mac mit Hashwerten zur Erkennung von Kindesmissbrauch bekanntgegeben. Dieser wird allerdings nur ein Teil einer größer angelegten Offensive zum Thema Kindersicherheit sein, die zunächst ausschließlich in den USA, später aber auch in anderen Regionen, mit iOS 15, iPadOS 15 und macOS Monterey umgesetzt wird.

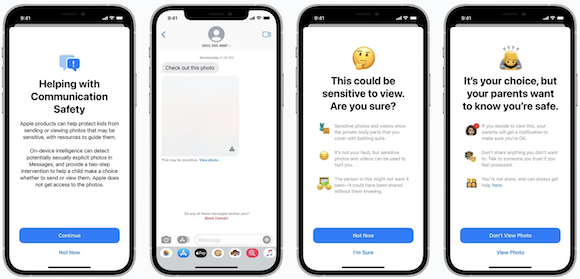

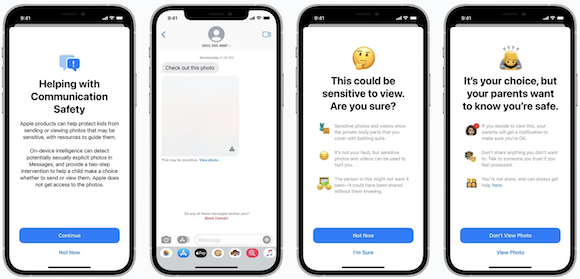

Mit einbezogen wird dabei auch iMessage, welches mit einer "Communication Safety" Funktion ausgestattet wird, die Kinder und ihre Eltern warnt, sobald sexuell anzügliche Fotos empfangen werden. Die Erkennung funktioniert auch in diesem Fall auf Basis von Maschinenlernen und findet komplett lokal auf dem Gerät statt. Sollte die Funktion anspringen, wird das empfangene Bild automatisch verschwommen dargestellt und eine entsprechende Meldung angezeigt. Sind die entsprechenden Schalter in der Familienfreigabe aktiviert, können sich auch Eltern über den Empfang eines solchen Bildes informieren lassen.

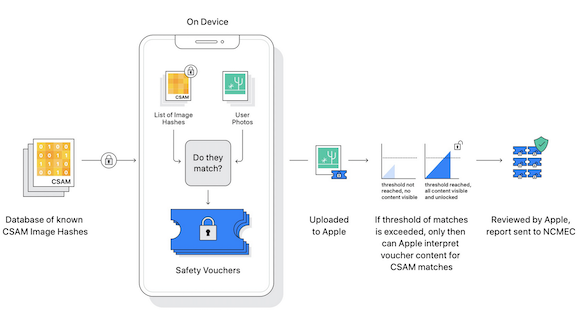

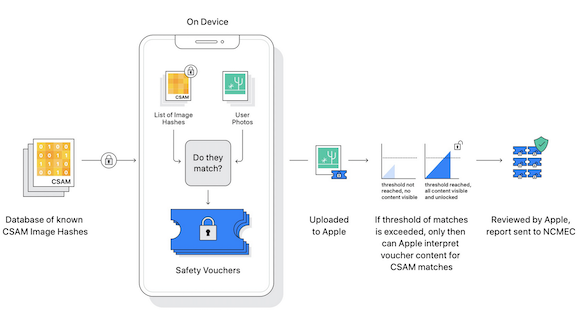

Ebenfalls mit iOS 15 und iPadOS 15 wird Apple die heute Nachmittag thematisierte automatische Erkennung von Bildern mit sogenanntem "Child Sexual Abuse Material" (CSAM), als Darstellungen von sexuellem Missbrauch von Kindern umsetzen. Wurden mehrere solcher Bilder in einem Account entdeckt, meldet Apple dies an das National Center for Missing and Exploited Children (NCMEC), eine Non-Profit -Organisation, die mit den Strafverfolgungsbehörden in den USA zusammenarbeitet. Dabei betont Apple, dass man auch bei der CSAM-Erkennung den Datenschutz in den Mittelpunkt stelle. Wie bereits berichtet, wird die Erkennung der Bilder auf Basis von Hashwerten aus der Datenbank der NCMEC und anderen Organisationen für den Schutz des Kindeswohls durchgeführt. Die dabei zum Einsatz kommende Technologie hört auf den Namen "NeuralHash" und vergleicht Hashwerte von Bildern auf denen Kindesmissbrauch zu sehen ist mit denen auf den Geräten. Hierzu schreibt das Unternehmen in einem neuen Whitepaper:

"The main purpose of the hash is to ensure that identical and visually similar images result in the same hash, while images that are different from one another result in different hashes,. For example, an image that has been slightly cropped, resized or converted from color to black and white is treated identical to its original, and has the same hash."

Die Bilderkennung wird wie gesagt auf dem Gerät selbst durchgeführt, bevor die Fotos auf iCloud Fotos hochgeladen werden. Wurde dabei eine Übereinstimmung festgestellt, wird das Bild entsprechend gekennzeichnet und anschließend hochgeladen. Wurde eine nicht näher benannte Anzahl von Übereinstimmungen bei einem Account festgestellt, werden diese manuell überprüft, der betroffene iCloud-Account deaktiviert und eine Meldung an das NCMEC getätigt. Zwar macht Apple zu dem Vorgang keine konkreten Angaben, versichert aber, dass man für einen "extremely high level of accuracy" sorgen und sogenannte "False-Positives" so weit es geht minimieren werde. Sämtliche Informationen hierzu lassen sich einer veröffentlichten technischen Dokumentation und der neuen Child Safety Webseite entnehmen.

Als dritte Maßnahme wird Apple Anpassungen bei Siri und der Spotlight-Suche auf all seinen Geräten vornehmen, um weiter sicherzustellen, dass sich Eltern und ihre Kinder sicher im Internet bewegen können und schnelle Hilfe in unsicheren Situationen erhalten. Beispielsweise werden entsprechende Ressourcen angeboten, wenn Nutzer Siri fragen, wie und wo sie Kindesmissbrauch melden können.

Wie bereits weiter oben erwähnt, werden sämtliche Neuerungen in diesem Herbst mit iOS 15, iPadOS 15, watchOS 8 und macOS Monterey eingeführt. Dies gilt zunächst ausschließlich für die USA, soll jedoch schrittweise auch auf andere Regionen ausgeweitet werden.

Apple hat zusätzlich zu seinem bereits liebgewonnenen "Movie Mittwoch" nun auch den "Blockbuster fürs Wochenende" ins Leben gerufen. Dabei wird jedes Wochenende ein ausgewählter Film aus dem iTunes-Sortiment für 24 Stunden zum Sonderpreis von nur € 0,99 in HD-Qualität zum Leihen angeboten. In dieser Woche handelt es sich um den Animationsfilm Hote Transsilvanien 3 - Ein Monster Urlaub, den man zum Sonderpreis von € 0,99 erhält. Nachdem man den Leih-Film geladen hat, kann er innerhalb von 30 Tagen angeschaut werden. Wie immer bei geliehenen Filmen aus dem iTunes Store gilt: Hat man hiermit einmal begonnen, muss man ihn innerhalb von 48 Stunden beenden.

Apple hat zusätzlich zu seinem bereits liebgewonnenen "Movie Mittwoch" nun auch den "Blockbuster fürs Wochenende" ins Leben gerufen. Dabei wird jedes Wochenende ein ausgewählter Film aus dem iTunes-Sortiment für 24 Stunden zum Sonderpreis von nur € 0,99 in HD-Qualität zum Leihen angeboten. In dieser Woche handelt es sich um den Animationsfilm Hote Transsilvanien 3 - Ein Monster Urlaub, den man zum Sonderpreis von € 0,99 erhält. Nachdem man den Leih-Film geladen hat, kann er innerhalb von 30 Tagen angeschaut werden. Wie immer bei geliehenen Filmen aus dem iTunes Store gilt: Hat man hiermit einmal begonnen, muss man ihn innerhalb von 48 Stunden beenden.

Apple hat mal wieder einen neuen "First Look" Clip für einen demnächst startenden Apple TV+ Inhalt auf seinem YouTube-Kanal veröffentlicht. Dabei handelt es sich um die Comedy-Serie "Mr. Corman", in der Joseph Gordon-Levitt die Hauptrolle spielt und auch als Produzent agiert und die ab heute auf Apple TV+ zu sehen ist. So stehen inzwischen die ersten beiden der insgesamt zehn Folgen der ersten Staffel zum Streamen über Apple TV+ zur Verfügung. Weitere Folgen werden im gewohnten Wochenrhythmus jeweils freitags ergänzt. Inhaltlich geht es in "Mr. Corman" um einen gleichnamigen Grundschullehrer in Los Angeles und dessen Leben innerhalb und außerhalb der Schule.

Apple hat mal wieder einen neuen "First Look" Clip für einen demnächst startenden Apple TV+ Inhalt auf seinem YouTube-Kanal veröffentlicht. Dabei handelt es sich um die Comedy-Serie "Mr. Corman", in der Joseph Gordon-Levitt die Hauptrolle spielt und auch als Produzent agiert und die ab heute auf Apple TV+ zu sehen ist. So stehen inzwischen die ersten beiden der insgesamt zehn Folgen der ersten Staffel zum Streamen über Apple TV+ zur Verfügung. Weitere Folgen werden im gewohnten Wochenrhythmus jeweils freitags ergänzt. Inhaltlich geht es in "Mr. Corman" um einen gleichnamigen Grundschullehrer in Los Angeles und dessen Leben innerhalb und außerhalb der Schule. Wer heute in die App-Updates auf seinem iPhone schaut und in der Vergangenheit in Sachen Wetter-App auf den einstigen Platzhirschen

Wer heute in die App-Updates auf seinem iPhone schaut und in der Vergangenheit in Sachen Wetter-App auf den einstigen Platzhirschen

Apples gestrige Ankündigung neuer Funktionen für einen besseren Schutz von Kindern auf seinen Geräten hat für eine Menge Aufsehen und Wirbel gesorgt. Inzwischen hat das Unternehmen mit ein paar weiteren Informationen und Klarstellungen nachgelegt. Eine der neuen Funktionen ist das Abgleichen von lokal auf einem iPhone oder iPad gespeicherten Fotos mit Hashwerten, um auf diese Weise Aufnahmen von sexuellem Missbrauch von Kindern zu entdecken. War dies der Fall, werden die betroffenen Bilder für den Nutzer unsichtbar markiert, bevor sie auf iCloud Fotos hochgeladen werden. Im Falle von vermehrten Erkennungen auf einem Account wird dieser gesperrt und der Nutzer von Apple an die zuständigen Behörden gemeldet. Hierbei handelt es sich um eine automatische Funktion, die vom Nutzer nicht deaktiviert werden kann. Allerdings hat Apple nun den Kollegen von

Apples gestrige Ankündigung neuer Funktionen für einen besseren Schutz von Kindern auf seinen Geräten hat für eine Menge Aufsehen und Wirbel gesorgt. Inzwischen hat das Unternehmen mit ein paar weiteren Informationen und Klarstellungen nachgelegt. Eine der neuen Funktionen ist das Abgleichen von lokal auf einem iPhone oder iPad gespeicherten Fotos mit Hashwerten, um auf diese Weise Aufnahmen von sexuellem Missbrauch von Kindern zu entdecken. War dies der Fall, werden die betroffenen Bilder für den Nutzer unsichtbar markiert, bevor sie auf iCloud Fotos hochgeladen werden. Im Falle von vermehrten Erkennungen auf einem Account wird dieser gesperrt und der Nutzer von Apple an die zuständigen Behörden gemeldet. Hierbei handelt es sich um eine automatische Funktion, die vom Nutzer nicht deaktiviert werden kann. Allerdings hat Apple nun den Kollegen von  Die Ankündigung, Verschiebung und letztliche Einstellung der Arbeit an der kabellosen Universal-Ladematte AirPower muss wohl als einer der größeren Fehlschläge in der jüngeren Apple-Vergangenheit einsortiert werden. Ursprünglich gemeinsam mit dem iPhone X vorgestellt, sollte die Ladematte in der Lage sein, gleichzeitig ein iPhone, eine Apple Watch und ein AirPods-Ladecase kabellos aufzuladen und zwar unabhängig davon, wo man die Geräte auf der Matte ablegte. Eine Ankündigung, die großes Staunen auslöste, an der die Apple-Ingenieure allerdings letzendlich, wohl aufgrund einer zu starken Hitzeentwicklung scheiterten. Allerdings gab es in den vergangenen Monaten immer mal wieder Meldungen, dass das Projekt doch noch nicht komplett gestorben sei und ein kleines Team nach wie vor daran forschte.

Die Ankündigung, Verschiebung und letztliche Einstellung der Arbeit an der kabellosen Universal-Ladematte AirPower muss wohl als einer der größeren Fehlschläge in der jüngeren Apple-Vergangenheit einsortiert werden. Ursprünglich gemeinsam mit dem iPhone X vorgestellt, sollte die Ladematte in der Lage sein, gleichzeitig ein iPhone, eine Apple Watch und ein AirPods-Ladecase kabellos aufzuladen und zwar unabhängig davon, wo man die Geräte auf der Matte ablegte. Eine Ankündigung, die großes Staunen auslöste, an der die Apple-Ingenieure allerdings letzendlich, wohl aufgrund einer zu starken Hitzeentwicklung scheiterten. Allerdings gab es in den vergangenen Monaten immer mal wieder Meldungen, dass das Projekt doch noch nicht komplett gestorben sei und ein kleines Team nach wie vor daran forschte. Thriller-Fans dürfen sich auf einen weiteren Neuzugang für Apple TV+ freuen. Wie die Kollegen von

Thriller-Fans dürfen sich auf einen weiteren Neuzugang für Apple TV+ freuen. Wie die Kollegen von

Puh, schwieriges Thema... Schon seit einiger Zeit ist das iPhone ja bekanntermaßen in der Lage, die lokal gespeicherten Fotos auf deren Inhalte zu analysieren und dabei beispielsweise Objekte oder auch Gesichter zu erkennen. Diese Funktion wird ab morgen offenbar weiter ausgebaut. So berichtet der Sicherheitsforscher und Professor an der Johns Hopkins University

Puh, schwieriges Thema... Schon seit einiger Zeit ist das iPhone ja bekanntermaßen in der Lage, die lokal gespeicherten Fotos auf deren Inhalte zu analysieren und dabei beispielsweise Objekte oder auch Gesichter zu erkennen. Diese Funktion wird ab morgen offenbar weiter ausgebaut. So berichtet der Sicherheitsforscher und Professor an der Johns Hopkins University